【AI智能体】进阶配置-优化大模型响应时间

本文介绍如何通过压缩方法名、自定义编码、避免嵌套结构以及使用中文数字替代阿拉伯数字等方式,减少输出的 Token 数量,从而有效降低大模型的响应时间。你可以根据实际应用场景选择合适的优化策略,提升大模型的性能和用户体验。

本文介绍如何通过压缩方法名、自定义编码、避免嵌套结构以及使用中文数字替代阿拉伯数字等方式,减少输出的 Token 数量,从而有效降低大模型的响应时间。你可以根据实际应用场景选择合适的优化策略,提升大模型的性能和用户体验。

大模型响应时间计算公式

大模型响应时间计算公式如下:

latency = ttft + output_token_num * tpot其中:

- ttft(Time To First Token):第一个 Token 响应的时间,即模型生成第一个输出 Token 所需的时间。该值主要由大模型的架构和部署环境决定,通常难以直接优化。

- output_token_num:大模型输出的 Token 数量。减少输出的 Token 数量可以直接降低响应时间。

- tpot(Time Per Output Token):大模型在首个 Token 输出后,后续输出每个 Token 所需的时间。该值同样取决于大模型的性能和部署环境。

因此,你可以通过优化大模型输出的 Token 数量,来降低大模型的响应时间。

优化手段

|

优化手段 |

详细说明 |

举例 |

|

压缩方法名和参数 |

压缩工作流或插件工具的方法名和参数。 |

将工具的方法名 getCountry 压缩为 gc,getWeather 压缩为 gw。 |

|

自定义编码 |

将意图识别结果编码为简化的数字或符号。 |

你是一个意图识别专家,如果用户需要联网搜索,返回 1,如果用户需要英语陪聊,返回 2。 |

|

不使用 JSON、XML 等嵌套结构 |

使用自定义的格式来代替 JSON、XML 的嵌套结构,例如使用管道符、CSV 格式等。 |

将以下 JSON 格式转换为管道符格式: 管道符 | 的格式: |

|

使用中文替代阿拉伯数字 |

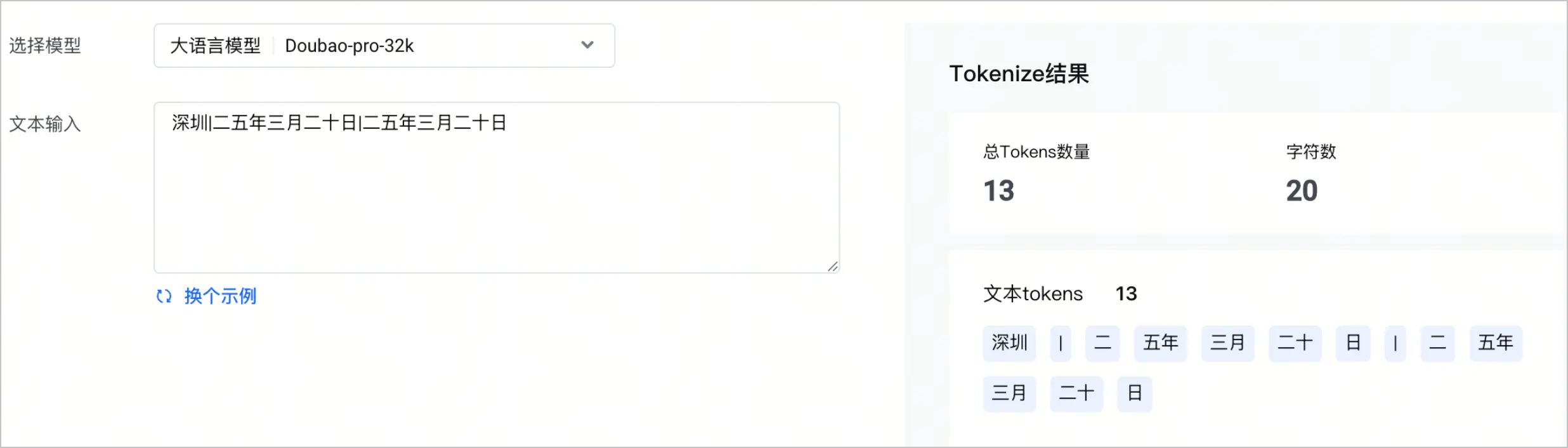

使用中文数字替代阿拉伯数字。 |

将 2025-03-20 转换为二五年三月二十日。 |

说明:

你可以通过方舟 Token 计算器预估输入的内容需要消耗的 Token。

实战案例

以下是天气参数提取案例的对比情况。通过优化系统提示词,将阿拉伯数字改为中文,并把 JSON 嵌套结构换成管道符格式后,大模型的输出效果、消耗的 Token 数量和响应时间都发生了变化。

|

类别 |

优化前 |

优化后 |

|

系统提示词 |

|

|

|

大模型的输出 |

|

|

|

消耗的 Token |

消耗的 Token 数量为 47。

|

消耗的 Token 数量为 13。

|

|

响应时间 |

1,175 ms (按 TPOT 25ms 计算) |

325 ms(按 TPOT 25ms 计算) |

扣子大模型节点的配置和运行示例如下图所示。

GitCode 天启AI是一款由 GitCode 团队打造的智能助手,基于先进的LLM(大语言模型)与多智能体 Agent 技术构建,致力于为用户提供高效、智能、多模态的创作与开发支持。它不仅支持自然语言对话,还具备处理文件、生成 PPT、撰写分析报告、开发 Web 应用等多项能力,真正做到“一句话,让 Al帮你完成复杂任务”。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

所有评论(0)