K210芯片高清摄像头替换指南

通过上述步骤,你可以将自定义YOLOv8模型高效部署到K210,结合高清摄像头提升边缘端检测性能。层替代大卷积(K210对Focus层支持较好)。:允许动态输入尺寸(适配K210的灵活部署)。(但K210的KPU仅部分支持浮点)。:确保预处理与训练时一致(如归一化为。:确保固件支持目标模型输入尺寸。:简化模型结构(删除冗余算子)。:输入尺寸/归一化方式不匹配。将训练好的YOLOv8模型(图片需缩放

将训练好的YOLOv8模型(.pt或.best文件)转换为K210芯片支持的.kmodel格式,需要通过模型量化、格式转换、兼容性适配等步骤。以下是详细的操作步骤和注意事项:

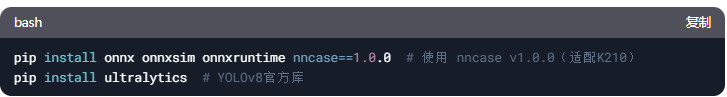

一、环境准备

-

安装依赖库:

-

下载工具链:

-

NNCase编译器:从GitHub Release下载对应操作系统的

nncase工具(如nncase-1.0.0.20220228.tgz)。 -

K210 SDK或MaixPy固件:确保固件支持目标模型输入尺寸。

-

二、转换步骤

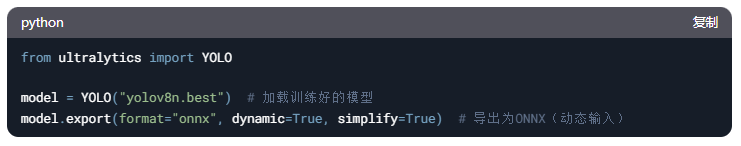

步骤1:将YOLOv8模型导出为ONNX格式

-

使用YOLOv8官方导出脚本:

-

关键参数:

-

dynamic=True:允许动态输入尺寸(适配K210的灵活部署)。 -

simplify=True:简化模型结构(删除冗余算子)。

-

-

-

验证ONNX模型:

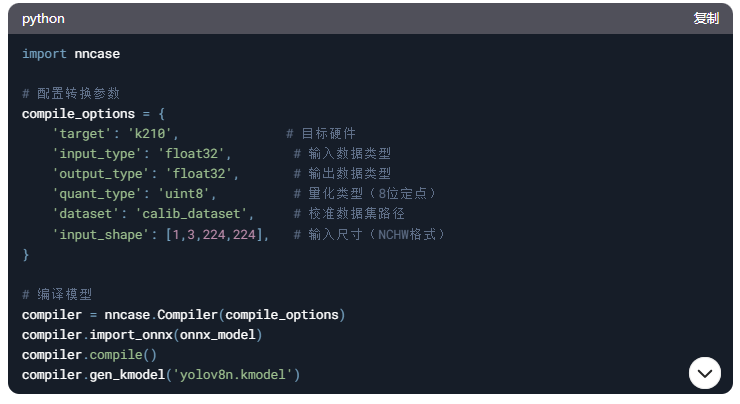

步骤2:使用NNCase将ONNX转换为KModel

-

生成校准数据集:

-

准备20-50张代表性图片(覆盖训练集场景),存放在

calib_dataset文件夹。 -

图片需缩放到模型输入尺寸(如

224x224)。

-

-

编写转换脚本(以Python为例):

-

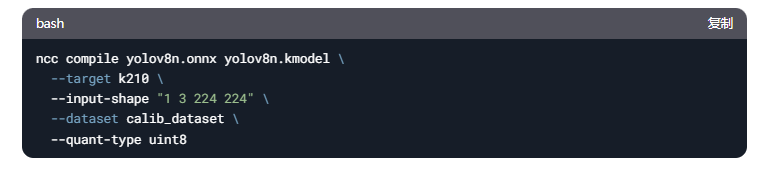

或使用命令行工具:

步骤3:验证KModel兼容性

-

在K210上测试模型(MaixPy示例):

步骤4:性能优化

-

量化策略调整:

-

若精度损失严重,尝试使用

--quant-type float16(但K210的KPU仅部分支持浮点)。 -

增大校准数据集多样性。

-

-

模型结构优化:

-

减少YOLO层输出通道数。

-

使用

Focus层替代大卷积(K210对Focus层支持较好)。

-

三、常见问题与解决

-

编译失败:不支持的算子

-

原因:KPU不支持某些算子(如

Slice、Reshape)。 -

解决:在导出ONNX前修改模型结构,或用

--no-optimize跳过算子融合。

-

-

推理结果异常

-

原因:输入尺寸/归一化方式不匹配。

-

解决:确保预处理与训练时一致(如归一化为

0-1或0-255)。

-

-

内存不足

-

原因:K210的6MB内存限制。

-

解决:降低输入分辨率(如从

320x320改为224x224)。

-

四、推荐工具与资源

-

NNCase官方文档:https://github.com/kendryte/nncase

-

MaixPy模型部署示例:https://github.com/sipeed/MaixPy_scripts

-

YOLOv8模型压缩工具:https://github.com/ultralytics/ultralytics

通过上述步骤,你可以将自定义YOLOv8模型高效部署到K210,结合高清摄像头提升边缘端检测性能。

GitCode 天启AI是一款由 GitCode 团队打造的智能助手,基于先进的LLM(大语言模型)与多智能体 Agent 技术构建,致力于为用户提供高效、智能、多模态的创作与开发支持。它不仅支持自然语言对话,还具备处理文件、生成 PPT、撰写分析报告、开发 Web 应用等多项能力,真正做到“一句话,让 Al帮你完成复杂任务”。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)