深入理解模型上下文协议(MCP):构建智能应用的关键桥梁

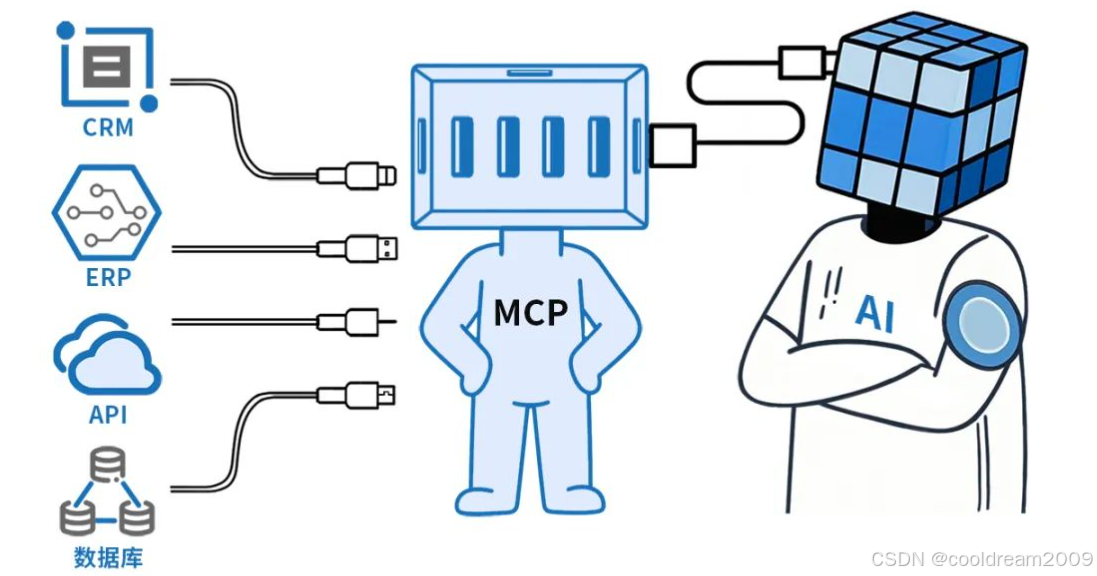

模型上下文协议(Model Context Protocol,简称 MCP)是构建智能 Agent 应用、复杂多轮对话系统以及插件系统的“桥梁”,帮助开发者将模型能力转化为更强大、更灵活的业务系统。本文将详细解析 MCP 的核心机制、应用价值与典型实现,帮助你理解这一协议在大模型生态系统中的重要作用。

目录

前言

随着大语言模型(LLM)在各类应用场景中的广泛使用,越来越多的开发者希望将模型能力与实际业务逻辑深度结合,构建具备工具调用能力、上下文记忆、智能任务拆解与协作的复杂系统。在这一过程中,一个关键问题浮出水面:如何让模型理解任务上下文、调用外部工具并保持多轮交互的有序性?

这正是 模型上下文协议(Model Context Protocol,简称 MCP) 诞生的背景。它是构建智能 Agent 应用、复杂多轮对话系统以及插件系统的“桥梁”,帮助开发者将模型能力转化为更强大、更灵活的业务系统。

本文将详细解析 MCP 的核心机制、应用价值与典型实现,帮助你理解这一协议在大模型生态系统中的重要作用。

1 MCP 协议简介

1.1 什么是 MCP(模型上下文协议)

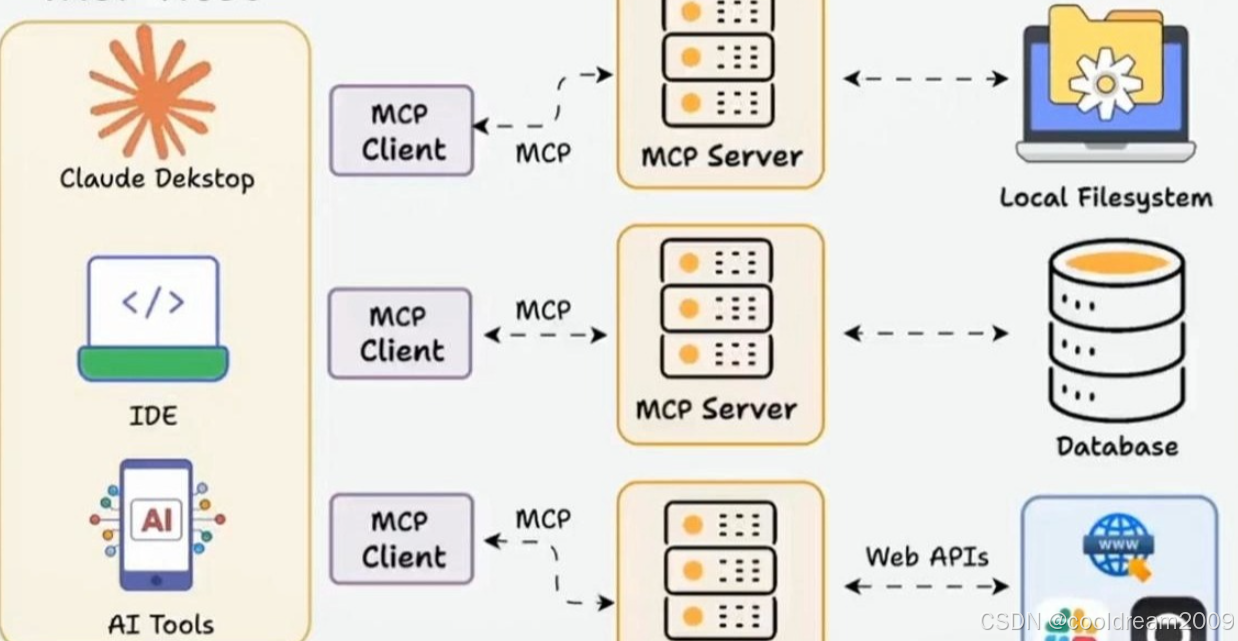

MCP(Model Context Protocol)是一种用于协调 大语言模型与外部系统之间交互行为的通信协议,其核心目标是:

- 标准化模型请求与响应中的上下文结构;

- 支持任务链式调用与工具/插件的插入执行;

- 保持多轮对话的一致性与可控性;

- 提供模型任务执行路径的可追踪性与可管理性。

相比于传统的 prompt 输入输出模式,MCP 更关注模型“在上下文中完成任务”的流程,而非单点的问答行为。这一协议的引入,显著提高了大模型在实际应用场景中的可控性、拓展性和稳定性。

1.2 MCP 与传统调用方式的区别

| 特性 | 传统模型调用 | MCP 协议调用 |

|---|---|---|

| 上下文处理 | 简单串联文本 | 结构化语义上下文 |

| 插件/工具支持 | 需自行设计接口 | 协议内支持调用规范 |

| 多轮交互 | 需要手动管理 | 自动保留与推理上下文 |

| 异步任务 | 难以实现 | 支持中间状态与回调 |

| Agent 调度 | 基本不支持 | 原生支持任务链路逻辑 |

MCP 协议不是某一具体厂商专属的实现,而是一种设计思想,已被 Dify、LangChain、Flowise、ChatDev 等多个开源平台吸收或改造应用。

2 MCP 的核心机制解析

2.1 上下文结构封装

MCP 最大的特点就是将模型的输入与输出结构化封装,不仅包含用户原始请求,还包括历史对话、调用记录、插件中间响应、Agent 决策信息等。

MCP 的一个基本请求结构通常包含:

- 用户输入(user_input)

- 当前上下文(context)

- 工具调用计划(tools_plan)

- Agent 状态(agent_state)

- 响应控制参数(response_control)

这种结构化封装使得模型在执行任务时能“理解前因后果”,具备连贯的任务处理能力。

2.2 插件与工具的统一抽象

MCP 将外部插件(如搜索、计算器、数据库、知识库等)抽象成统一的工具接口,并通过标准协议进行调用。模型可以发起指令:

{

"action": "call_tool",

"tool_name": "web_search",

"tool_input": "2025 年华为云发布会时间"

}

然后等待插件返回结构化结果,再继续对话。这一机制解耦了模型与工具之间的强绑定逻辑,使插件调用更加灵活、安全。

2.3 多轮对话与调用链管理

当模型需要执行复杂任务时,往往会经历“用户请求 → Agent 规划 → 工具调用 → 结果整合 → 用户输出”的多个阶段。MCP 为这种链式结构提供了天然支持。

开发者可以通过 MCP 记录整个调用链,包括:

- 每一步任务的输入输出;

- 工具调用是否成功;

- Agent 中间状态与 reasoning 内容;

- 最终模型生成回复的语义路径。

这样一来,整个交互链条变得可追溯、可分析、可调优,对实际生产系统极为重要。

2.4 异步任务与响应管理

有些插件调用(如文档检索、数据库查询、复杂运算等)需要一定等待时间。MCP 协议支持“挂起-恢复”机制,允许模型在等待工具返回时暂停任务,然后在结果返回后自动恢复执行。

这使得模型调用系统可以兼顾实时性与复杂性,不再受限于同步阻塞流程。

3 MCP 在实际应用中的价值

3.1 构建智能 Agent 系统

在 Dify、LangChain 等平台中,MCP 是智能 Agent 构建的基础协议。例如,在 Dify 平台中,通过 MCP 可以实现:

- Agent 自动分析用户意图;

- 自动选择并调用插件(如搜索、SQL 查询);

- 整合返回结果生成自然语言响应;

- 多轮记忆保持、上下文追踪;

- 插件调用失败时的 fallback 策略。

MCP 让模型从“问答工具”变成了“任务执行者”,能力大幅提升。

3.2 提高开发效率与系统可维护性

传统方式下,开发者需要手动拼接 prompt、管理上下文、接管工具调用结果。引入 MCP 后,这些都变成协议化处理,开发者只需专注业务逻辑编排即可,极大降低了系统复杂度。

此外,由于 MCP 提供结构化调用记录,系统的调试与监控也更方便。例如,当模型输出错误时,可以从 MCP 的调用日志中快速定位是哪一阶段出现了问题。

3.3 实现企业级可控性

在企业应用中,可靠性、安全性与审计能力至关重要。MCP 协议允许开发者记录:

- 所有模型交互内容;

- 插件调用过程;

- Agent 推理链路;

- 响应内容结构。

这一能力使得 MCP 成为构建企业级 LLM 应用(如智能客服、数据问答平台、业务流程机器人等)的关键基础。

4 MCP 实践示例(以 Dify 为例)

以下为一个简化的 MCP 结构在 Dify 中的使用示例:

{

"user_input": "请告诉我 2025 年华为云的 AI 战略",

"context": [

{"role": "user", "content": "今年的云计算趋势是什么?"},

{"role": "assistant", "content": "2025 年云计算将更多聚焦于 AIGC 与大模型落地..."}

],

"agent_state": {

"plan": "调用 web_search 工具获取最新信息",

"reasoning": "我不知道 2025 年战略内容,需要从网络检索"

},

"tool_call": {

"tool_name": "web_search",

"tool_input": "2025 年华为云 AI 战略"

},

"final_response": {

"content": "根据最新信息,华为云计划将大模型与产业深度融合,构建 AI+X 行业方案..."

}

}

通过这一结构,开发者不仅可以读取用户意图,还能掌握模型决策路径、工具调用过程及最终回应逻辑,实现对整个智能交互系统的精细化控制与优化。

5 未来展望与标准化路径

MCP 协议当前仍处于快速演化阶段,尚未形成统一行业标准。不过,随着 Dify、LangChain、OpenDevin、ChatDev 等系统的实践不断推进,一种去中心化的共识正在逐渐形成。

未来 MCP 有望向以下方向演进:

- 形成开放标准文档(如 OpenAPI for LLM Agent);

- 支持多语言、多模型兼容结构;

- 与安全审计、权限控制、敏感词过滤联动;

- 原生支持前端/移动端轻量交互模式;

- 与云平台无缝集成(如华为云、阿里云、Azure OpenAI 等)提供托管级 MCP 服务。

MCP 将不仅仅是开发协议,更将成为大模型系统生态中的“操作系统”。

结语

模型上下文协议 MCP 的出现,为构建复杂、智能、可控的大模型应用提供了强有力的支持。它不仅提升了系统的抽象能力,也大幅降低了开发门槛,是大语言模型从“工具”迈向“平台”的关键桥梁。

如果你正在构建基于大模型的智能助手、流程机器人或业务系统,强烈建议深入理解并采用 MCP 协议思想。在即将到来的 LLM 应用爆发时代,拥有“结构化思维”与“上下文管理能力”的系统,才是真正具备竞争力的智能平台。

GitCode 天启AI是一款由 GitCode 团队打造的智能助手,基于先进的LLM(大语言模型)与多智能体 Agent 技术构建,致力于为用户提供高效、智能、多模态的创作与开发支持。它不仅支持自然语言对话,还具备处理文件、生成 PPT、撰写分析报告、开发 Web 应用等多项能力,真正做到“一句话,让 Al帮你完成复杂任务”。

更多推荐

已为社区贡献27条内容

已为社区贡献27条内容

所有评论(0)