2024年大数据最全Python+大数据学习笔记(一)_inferschema=true(1),轻松拿到了阿里大数据开发高级开发工程师的offer

builder。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

from pyspark.sql import SparkSession

spark = SparkSession

.builder

.appName(“PythonWordCount”)

.master(“local[*]”)

.getOrCreate()

将文件转换为RDD对象

lines = spark.read.text(“input.txt”).rdd.map(lambda r: r[0])

counts = lines.flatMap(lambda x: x.split(’ '))

.map(lambda x: (x, 1))

.reduceByKey(lambda x, y: x + y)

output = counts.collect()

for (word, count) in output:

print(“%s: %i” % (word, count))

spark.stop()

### PySpark中的DataFrame

• DataFrame类似于Python中的数据表,允许处理大量结

构化数据

• DataFrame优于RDD,同时包含RDD的功能

从集合中创建RDD

rdd = spark.sparkContext.parallelize([

(1001, “张飞”, 8341, “坦克”),

(1002, “关羽”, 7107, “战士”),

(1003, “刘备”, 6900, “战士”)

])

指定模式, StructField(name,dataType,nullable)

name: 该字段的名字,dataType:该字段的数据类型,

nullable: 指示该字段的值是否为空

from pyspark.sql.types import StructType, StructField,

LongType, StringType # 导入类型

schema = StructType([

StructField(“id”, LongType(), True),

StructField(“name”, StringType(), True),

StructField(“hp”, LongType(), True), #生命值

StructField(“role_main”, StringType(), True)

])

对RDD应用该模式并且创建DataFrame

heros = spark.createDataFrame(rdd, schema)

heros.show()

利用DataFrame创建一个临时视图

heros.registerTempTable(“HeroGames”)

查看DataFrame的行数

print(heros.count())

使用自动类型推断的方式创建dataframe

data = [(1001, “张飞”, 8341, “坦克”),

(1002, “关羽”, 7107, “战士”),

(1003, “刘备”, 6900, “战士”)]

df = spark.createDataFrame(data, schema=[‘id’, ‘name’,

‘hp’, ‘role_main’])

print(df) #只能显示出来是DataFrame的结果

df.show() #需要通过show将内容打印出来

print(df.count())

3

DataFrame[id: bigint, name: string, hp: bigint, role_main:

string]

| id|name| hp|role_main|

±—±------±----±------------+

|1001|张飞|8341| 坦克|

|1002|关羽|7107| 战士|

|1003|刘备|6900| 战士| ±—±------±----±------------+ 3

从CSV文件中读取

heros = spark.read.csv(“./heros.csv”, header=True,

inferSchema=True)

heros.show()

• 从MySQL中读取

df = spark.read.format(‘jdbc’).options(

url=‘jdbc:mysql://localhost:3306/wucai?useUnicode=true&

useJDBCCompliantTimezoneShift=true&useLegacyDatetim

eCode=false&serverTimezone=Asia/Shanghai’,

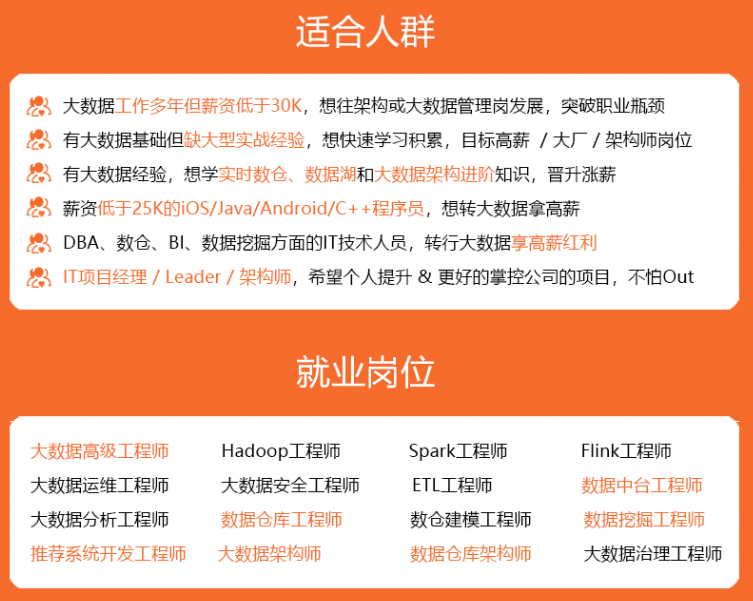

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

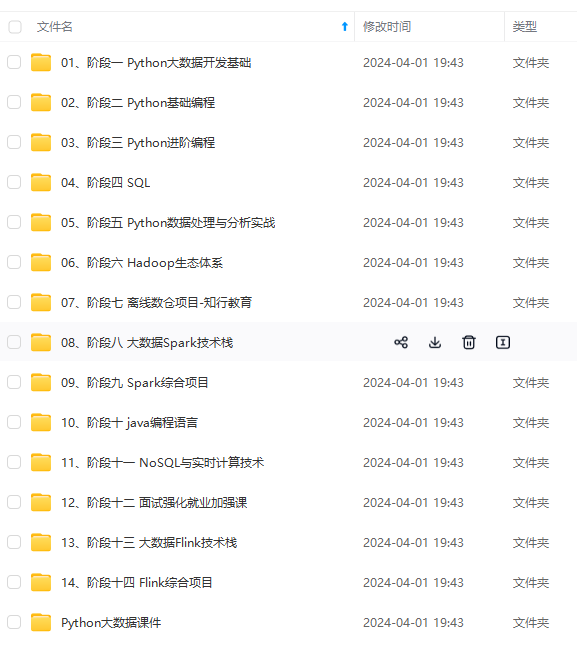

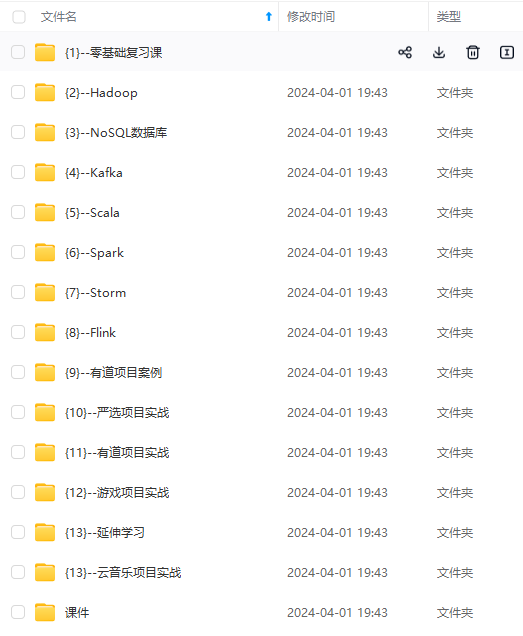

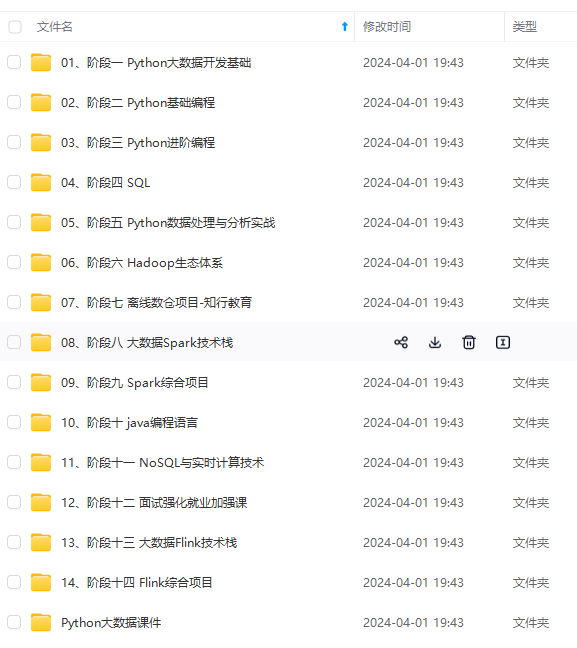

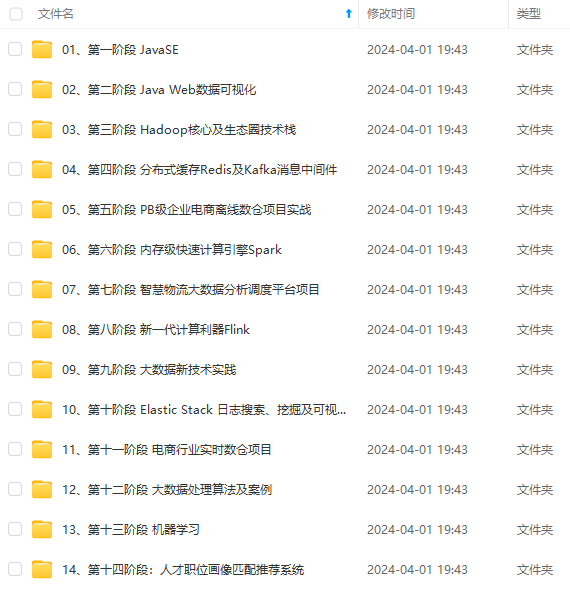

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

GitCode 天启AI是一款由 GitCode 团队打造的智能助手,基于先进的LLM(大语言模型)与多智能体 Agent 技术构建,致力于为用户提供高效、智能、多模态的创作与开发支持。它不仅支持自然语言对话,还具备处理文件、生成 PPT、撰写分析报告、开发 Web 应用等多项能力,真正做到“一句话,让 Al帮你完成复杂任务”。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)