初学python爬虫心得(豆瓣电影top250)

爬虫基础

一.准备工作

二.构建流程

三.获取网页数据

四.对数据进行正则提取

五.标签解析

一.准备工作

对于初学爬虫的人,我们在正式开始前需要先引入爬虫所需的相关模块。

对于简单的爬虫来说,我们大致需要引入这些模块:

from bs4 import BeautifulSoup # 网页解析,获取数据

import re # 正则表达式,进行文字匹配

import urllib.request

import urllib.error # 制定URL,获取网页数据

import xlwt # 进行excel操作

import sqlite3 # 进行SQLite数据库操作

他们的功能我已标到代码块中:

这些函数需要下载到环境中才能进行正常的使用,至于下载方式我就不在这里具体讲解了,大家可以去看一下相关视频。

二.爬虫流程

准备工作完成后,我们就开始正式开始了.

首先我们需要有一个清晰的流程,这是我的大致流程:

1.爬取网页(获取数据)

2.解析数据

3.保存数据

三.获取数据

这里我们需要添加一个网页询问函数,而且一些网页需要有头才可以正常爬取,所以我们最好添加一个询问函数时要加入头部。

具体代码如下:

def askURL(url):

head = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36 Edg/95.0.1020.44"}

request = urllib.request.Request(url, headers=head)

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode("utf-8")

# print(html)

except urllib.error.URLError as e:

if hasattr(e, "code"):

print(e.code)

if hasattr(e, "reason"):

print(e.reason)

return html

def main():

baseurl = "http://movie.douban.com/top250?start="

datalist = getData(baseurl)

askURL("http://movie.douban.com/top250?start=")

四.对数据进行正则提取

解析数据算是这个里面比较困难的了,这里我们会用到正则提取,Beautifulsoap表达式。

其中基础的正则提取的具体用法比较简单,你们可以去看一些简单的例子或视频就能理解现阶段我们使用的正则提取式。

这里我给你们看下我写的爬虫的正则提取式的用法。

findLink = re.compile(r'<a href="(.*?)">')

首先我们需要在主函数中写出正则规则(因为正则提取我们可能会在多个函数中使用,所以一般写在主函数中,你们也可以写在其他地方,只要可以保证正则提取可以正常使用即可)

接下来可以进行正则提取了!

link = re.findall(findLink, item)[0]

后面的0是只提取第一次出现的信息

Beautifulsoap可以解析网页,获取数据,但其不能针对性的获取数据,要针对性的获取数据就需要使用正则提取。

具体用法如下:

soup = BeautifulSoup(html, "html.parser")

** 五.标签解析**

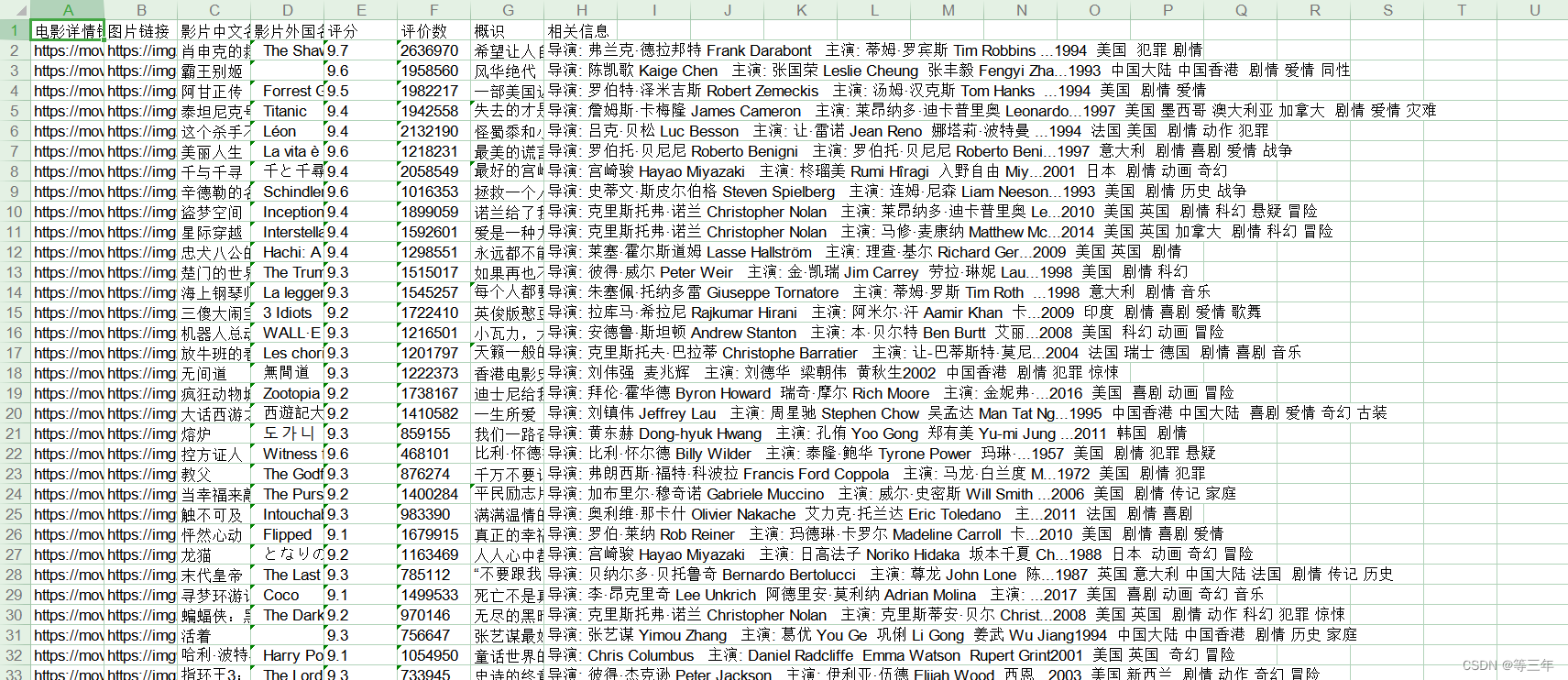

对得到的数据进行保存,我们可以直接将其保存到Excel中,这里我们就需要使用xlwt表达式了.

这里先上代码,下面好进行解释

book = xlwt.Workbook(encoding="utf-8", style_compression=0)

sheet = book.add_sheet('豆瓣电影Top250', cell_overwrite_ok=True)

col = ("电影详情链接", "图片链接", "影片中文名", "影片外国名", "评分", "评价数", "概识", "相关信息")

for i in range(0, 8):

sheet.write(0, i, col[i])

for i in range(0, 250):

print("第%d条" % (i + 1))

data = datalist[i]

for j in range(0, 8):

sheet.write(i + 1, j, data[j])

book.save(savepath)

xlwt表达式的用法大家可以自学一下较基础的就可以完成初级爬虫了。

这里我先说第一个循环:它是将数据依次填写到第一行中各方格内

下面的嵌套循环就是把提取到的数据按上面第一行的标题进行排列

如下图:

源代码如下:

# -*- coding =utf-8 -*-

# @Time :2022/6/19 20:52

# @Author :JIA

# @File :爬虫1.py

# @software:PyCharm

from bs4 import BeautifulSoup

import re

import urllib.request

import urllib.error

import xlwt

import sqlite3

def main():

baseurl = "http://movie.douban.com/top250?start="

datalist = getData(baseurl)

savepath = ".\\豆瓣电影Top250.xls"

saveData(datalist, savepath)

findLink = re.compile(r'<a href="(.*?)">')

findImgSrc = re.compile(r'<img.*src="(.*?)"', re.S)

findTitle = re.compile(r'<span class="title">(.*)</span>')

findRating = re.compile(r'<span class="rating_num" property="v:average">(.*)</span>')

findJudge = re.compile(r'<span>(\d*)人评价</span>')

findInq = re.compile(r'<span class="inq">(.*)</span>')

findBd = re.compile(r'<p class="">(.*?)</p>', re.S)

def getData(baseurl):

datalist = []

for i in range(0, 10):

url = baseurl + str(i * 25)

html = askURL(url)

soup = BeautifulSoup(html, "html.parser")

for item in soup.find_all('div', class_="item"):

data = []

item = str(item)

link = re.findall(findLink, item)[0]

data.append(link)

imgSrc = re.findall(findImgSrc, item)[0]

data.append(imgSrc)

titles = re.findall(findTitle, item)

if (len(titles) == 2):

ctitle = titles[0]

data.append(ctitle)

otitle = titles[1].replace("/",'')

data.append(otitle)

else:

data.append(titles[0])

data.append(' ')

rating = re.findall(findRating, item)[0]

data.append(rating)

judgeNum = re.findall(findJudge, item)[0]

data.append(judgeNum)

inq = re.findall(findInq, item)

if len(inq) != 0:

inq = inq[0].replace("。", "")

data.append(inq)

else:

data.append(" ")

bd = re.findall(findBd, item)[0]

bd = re.sub('<br(\s+)?/>(\s+)?', "", bd)

bd = re.sub('/', "", bd)

data.append(bd.strip())

datalist.append(data)

return datalist

def askURL(url):

head = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36 Edg/95.0.1020.44"}

request = urllib.request.Request(url, headers=head)

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode("utf-8")

except urllib.error.URLError as e:

if hasattr(e, "code"):

print(e.code)

if hasattr(e, "reason"):

print(e.reason)

return html

def saveData(datalist, savepath):

print("save...")

book = xlwt.Workbook(encoding="utf-8", style_compression=0)

sheet = book.add_sheet('豆瓣电影Top250', cell_overwrite_ok=True)

col = ("电影详情链接", "图片链接", "影片中文名", "影片外国名", "评分", "评价数", "概识", "相关信息")

for i in range(0, 8):

sheet.write(0, i, col[i])

for i in range(0, 250):

print("第%d条" % (i + 1))

data = datalist[i]

for j in range(0, 8):

sheet.write(i + 1, j, data[j])

book.save(savepath)

if __name__ == "__main__":

main()

print("爬取完毕")

原创不易,禁止转载,禁止抄袭

GitCode 天启AI是一款由 GitCode 团队打造的智能助手,基于先进的LLM(大语言模型)与多智能体 Agent 技术构建,致力于为用户提供高效、智能、多模态的创作与开发支持。它不仅支持自然语言对话,还具备处理文件、生成 PPT、撰写分析报告、开发 Web 应用等多项能力,真正做到“一句话,让 Al帮你完成复杂任务”。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)